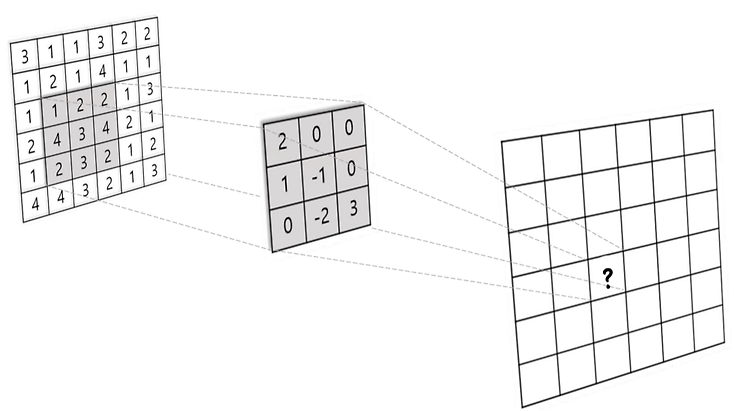

레이어 레이어 : 유용한 연산자 집합 머신러닝 모델은 단순한 레이어를 쌓고 조합하여 표현할 수 있다. 텐서플로우는 여러 표준 레이어를 제공하기 때문에 처음부터 고유의 프로그램에 최적화된 레이어를 작성하거나 기존 레이어를 조합해 쉽게 모델을 만들 수 있다. 텐서플로우는 케라스의 모든 API를 tf.keras에 포함하고 있다. 여기서 얻어낸 케라스 레이어로 모델을 구축하면 된다. 대부분의 레이어는 처음 파라미터로 출력차원의 크기 혹은 채널을 가진다. 입력 차원의 수는 따로 설정하지 않아도 유추하지만 그래도 모델이 복잡할 경우 입력해주는 것이 좋다. layer = tf.keras.layers.Dense(10, input_shape=(None, 5)) 위는 레이어의 한 종류인 완전 연결 레이어이다. layer...